Модерация контента в Make звучит красиво в заголовках: AI-проверки за 5 шагов, всё само, вы только чай наливаете. Но если смотреть из России, с 152-ФЗ, Роскомнадзором и локализацией данных, картинка меняется. Модерация контента в Make в наших реалиях — это не про «магический модуль», а про продуманную связку: чекбоксы согласий, фильтры персональных данных, российский ИИ и аккуратные журналы. В этой статье я разложу по полочкам, как настроить модерацию Make так, чтобы не ловить штрафы и не делать из себя вручную работающего модератора.

Писать буду для тех, кто уже что-то автоматизировал: фрилансеры, небольшие студии, владельцы сервисов и те, кто крутит n8n, Make и ИИ-агентов nights & weekends. Будет много практики, немного иронии и ноль магии. И сразу закину крючок для сюжета: ко мне пришел клиент — Саша, руководитель небольшой онлайн-школы по 3D-дизайну. Он собирал отзывы, заявки и комментарии через сайт и Telegram-бота, а модераторов у него не было принципиально. Люди не успевали, и он хотел, чтобы Make сам отсекал токсичку и ПДн, а в Роскомнадзор ходить не тянуло вообще. Я покажу, как мы с ним вытащили этот клубок за 5 шагов и не превратились в героев сводок по штрафам.

Я часто вижу одну и ту же картинку: владелец проекта радостно включает ИИ-проверку комментариев, Make бодро тянет всё подряд из форм и чатов, а где-то в углу грустит неоформленное уведомление в РКН и отсутствующий журнал обработки ПДн. В теории, модерация make ии — это просто: AI смотрит текст, ставит флаг «токсично/нет», «спам/нет», «есть ПДн/нет», дальше сценарий решает, публиковать ли. В практике по 152-ФЗ к этому добавляется еще несколько слоёв: согласия, минимизация, локализация, разграничение доступа, уничтожение данных и акты.

С тем же Сашей история началась почти комично. Он прислал мне таблицу с отзывами, где в одном поле вперемешку шли: «Спасибо за курс, Иван Иванов, Москва, паспорт такой-то» и «Курс огонь, но оплату сделайте не через банк, а вот тут ;)». Я спросила, есть ли у него политика обработки ПДн и регистрация как оператора, на что он искренне удивился: «Я же просто отзывы собираю, это же не банк». Роскомнадзор, увы, думает иначе. С 2025 года даже фрилансер с формой заявки на сайте обязан уведомить РКН, если собирает ФИО, email, телефон или IP, и это не шутка.

Чтобы не тонуть в абстрактных страшилках, мы сначала описали, какие типы контента у него бегают через Make: отзывы на сайте, заявки на консультацию, сообщения в Telegram-чате и формы на вебинарах. Везде всплывали ПДн: минимум имя и контакт, иногда паспортные данные, иногда биометрия (фото в аватарке и видео-отзывы). Это критично, потому что модерация контента не живет отдельно от обработки ПДн: если ИИ видит текст, он по факту обрабатывает данные, и закон к этому относится так же серьезно, как к обычной CRM.

В параллель я открыла свой заметочник, где уже были схемы по регистрации в РКН, типовым ОРД и примерам для журналов. Здесь сильно выручает привычка из внутреннего аудита: сначала карта процесса, потом автоматизация. Мы с Сашей набросали: откуда данные приходят, через какие сценарии Make проходят, где хранятся (Dropbox, Google, локальный сервер), кто к ним лезет и что с ними происходит по финалу. Чуть позже именно эта карта помогла не запутаться, когда мы подключали ИИ-фильтры и журналы.

Читателю эта история нужна не ради драмы, а ради референса. Если ты тоже собираешь отзывы, заявки, комментарии и все это летит в один большой Make-сценарий, то твоя точка старта примерно там же, где был Саша: ПДн уже есть, ИИ уже что-то трогает, а формальных оснований для этого может не быть. Это означает, что без системной настройки модерации make ты работаешь на доверии к автоматизации, а не на правовом фундаменте. Дальше покажу, как выстроить этот фундамент без истерик и тонна бумажной волокиты.

С чем сталкивается модерация контента в России по 152-ФЗ

Если коротко: модерация контента у нас упирается не в технологии, а в правовую базу и дисциплину. С 2025 года почти любой, кто собирает ПДн, формально становится оператором: интернет-магазин, микробизнес, фрилансер с лендингом и формой, онлайн-школа. Роскомнадзор в этой истории больше не страшилка из новостей, а обычный регулятор, который умеет делать дистанционные проверки журналов и логов, опираясь на свои автоматизированные системы. И ИИ-модерация тут попадает в их фокус так же, как CRM или сервис рассылок.

Я заметила, что большинство проблем начинается с двух фраз: «у нас нет ПДн, только имя и телефон» и «AI же просто проверяет текст». Имя и телефон — это уже персональные данные, а AI-модерирование текста с ФИО и email ничем не отличается от ручной обработки с точки зрения закона. Плюс, Make — это средство вычислительной техники (да, вот так сухо), через которое происходит автоматизированная обработка ПДн, а значит всплывает необходимость согласий именно на автоматизированную обработку. Тут многие спотыкаются и пытаются закрыть вопрос какой-нибудь общей галочкой на сайте.

Чтобы не перегружать теорией, удобнее зафиксировать ключевые установки в виде небольшой цитаты, к которой можно возвращаться глазами.

Автоматизация модерации в Make законна и удобна, если три вещи соблюдены одновременно: есть уведомление в РКН, есть корректные согласия на автоматизированную обработку, а сами сценарии Make минимизируют ПДн и логируют доступ.

В российских кейсах я всё чаще вижу связку с LegalTech-инструментами и DPO-сервисами уровня PrivacyLine и QForm. Они не про модерацию контента как таковую, но помогают закрыть вторую половину задачи: структурировать процессы, реестры, журналы, акты уничтожения и согласия. Make в этой схеме становится «двигателем конвейера», но без правильной обвязки легко превратиться в источник рисков. Особенно, если сценарии строит не юрист, а условный маркетолог с горящими дедлайнами.

Один из свежих трендов, который я вижу на конференциях по ИБ и LegalTech, — переход от слов «у нас всё хранится в Excel» к централизованным реестрам: процессы, категории ПДн, хранилища, правовые основания, сроки хранения. Как только это сделано, проектам намного проще объяснить себе, где именно нужна модерация, а где достаточно базовой валидации. Например, если вы храните комментарии пользователей 30 дней и дальше обезличиваете, то и Make-сценарий можно настраивать под эту логику, а не держать всё «на всякий случай» годами.

Мне нравится проводить аналогию с обычной почтой. Раньше мы вручную чистили ящик: заходили, отбирали спам, удаляли. Потом появились фильтры: они ловят подозрительное, но именно вы решаете, отправить письмо в корзину или нет. Модерация make ии должна работать так же: ИИ предварительно маркирует контент по токсичности, спаму, наличию ПДн, но окончательное слово у вас или у назначенного модератора. Это критично, потому что полностью полагаться на ИИ — значит подписаться под его ошибками перед регулятором и клиентами.

Получается, что стартовая точка для аккуратной модерации контента в Make в России выглядит довольно скучно: регистрация в РКН, политика обработки ПДн, назначенный ответственный, карта процессов. Зато дальше жить спокойнее, и тот же Make уже не кажется чем-то опасным или «подозрительным» для проверяющих. В следующем блоке я разложу, как на этой базе собрать пятишаговый конструктор модерации, и вернемся к нашему Саше, который очень не хотел запоминать все аббревиатуры, но смирился.

Как регистрация оператора и согласия связаны с модерацией Make

Я часто слышу вопрос: «Ну я же всего лишь подключаю Make, зачем мне утруждаться регистрацией в РКН?». Формальный ответ неприятный: если вы через Make собираете заявки, отзывы, комментарии с ФИО, телефоном, email, IP или чем-то похожим, вы уже обрабатываете ПДн с использованием СВТ. Неважно, это делает CRM, Google-таблица или модуль модерации контента — для закона это всё одна история. Без уведомления в РКН и базовых ОРД модерация превращается в красивую, но рискованную надстройку.

На практике связка выглядит так: сначала вы определяете, какие именно формы и каналы подают данные в Make. Это может быть лендинг на Tilda, бот в Telegram, форма VK, Google Form. Затем под каждую точку сбора выстраиваете текст согласия, где прямо проговариваете автоматизированную обработку и использование ИИ-сервисов (хотя я сама формулировки про «ИИ» использую аккуратно, без фанатизма). В идеале эти согласия потом лечь в реестр и в будущем — в интеграцию с ЕСИА, когда регулятор подтянет этот формат до конца.

Чтобы зафиксировать связку регистрации и модерации, полезно выделить одну ключевую связующую фразу.

Согласие на автоматизированную обработку — это не формальность для юристов, а фактический «ключ», который разрешает Make и ИИ-модулю трогать контент пользователя.

В кейсе с Сашей мы начали именно с этого. Пока он настраивал тексты форм и чекбоксы, я аккуратно свела его процессы обработки в понятный реестр: какие категории ПДн он берет (контактные данные, платежные, косвенная биометрия из фото), для каких целей (обучение, маркетинг, аналитика), сколько хранит и как уничтожает. На этом фоне стало проще ответить на базовый вопрос: какой контент вообще должен доходить до модерации AI, а что лучше отсеивать еще на уровне формы.

Честно признаюсь, иногда такие разговоры вызывают усталость у владельцев бизнеса. Но без них модерация make превращается в странный инструмент: вроде бы очищает контент, но неочевидно, имеет ли она право вообще его анализировать. Я отношусь к этому как к чекапу: один раз потрудились, зарегистрировались в РКН, описали политику, сделали шаблоны согласий — дальше несколько лет просто живете спокойнее. И Make в этой конструкции уже не выглядит инородным телом, а становится рабочей лошадкой.

В итоге, если коротко, регистрация как оператора и согласия — это фундамент под всё, что вы делаете с ИИ и автоматизацией. У Саши после этой части появилось чувство контроля: он стал понимать, что именно он разрешает своим сценариям делать с данными, а не просто «включать модуль модерации». Дальше останется собрать из этого аккуратный пятишаговый конвейер в Make, о котором и пойдет речь дальше.

Как собрать безопасную модерацию в Make за 5 шагов

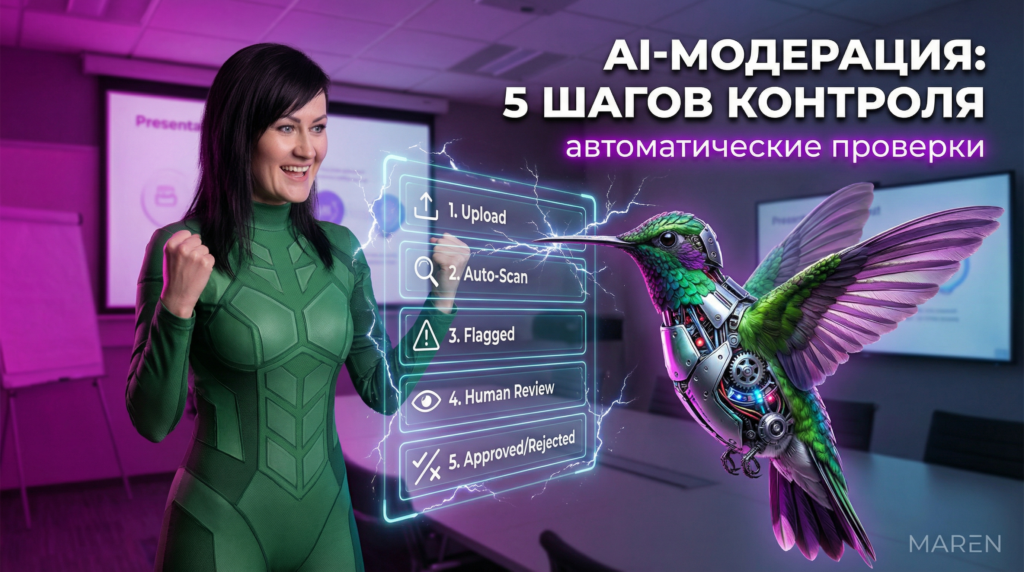

Базовая настройка модерации Make реально укладывается в 5 шагов, если не пытаться решить все задачи вселенной за один сценарий. Структура примерно такая: сбор данных через вебхук с чекбоксом согласия, фильтр минимизации ПДн, ИИ-проверка на токсичность/спам/ПДн, журналирование действий и уничтожение или блокировка данных по правилам. Звучит немного громоздко (хотя в интерфейсе это 8-10 модулей), но на практике такой подход спасает от лишних нервов при разговорах с аудиторами и проверяющими.

Я поняла, что лучше всего такая модель запоминается через один небольшой тезис, который повторяется во всех шагах.

Каждый шаг сценария должен либо снижать объем обрабатываемых ПДн, либо повышать прозрачность того, что с ними происходит.

Первый шаг — настройка вебхука в Make и форм, которые в него стучатся. Форма не должна собирать лишнего: если вы модерируете отзывы, не тяните дату рождения и паспортные данные «на всякий случай». Вебхук получает только те поля, которые реально нужны для модерации и дальнейшей публикации. Тут же прилетает флаг согласия: отметка чекбокса, текст согласия, возможно, версия политики. Без этого флага сценарий должен просто завершаться без обработки.

Дальше в дело вступает фильтр минимизации ПДн. Это отдельный модуль или блок логики, который проверяет содержимое текста на «лишние» данные: паспорт, СНИЛС, email, телефон, точный адрес. Частично это можно сделать регулярками, частично — через российский ИИ, обученный на поиске ПДн. Всё, что не нужно для цели (например, паспорт в отзыве о курсе), маскируется или вырезается до того, как текст уходит в основной модуль модерации.

Третий шаг — собственно ИИ-модерация. В Make это обычно HTTP-запрос к API ЯндексGPT или GigaChat через российский провайдер, с промптом в духе: «оцени, есть ли ненормативная лексика, признаки спама, призывы к противоправным действиям». В отдельном поле можно попросить модель отметить, видит ли она признаки ПДн без согласия (нет, подожди, правильнее сказать — без явных оснований). Идея в том, чтобы получить структурированный ответ: флаги по токсичности, спаму, ПДн, плюс небольшой комментарий.

Четвертый шаг — журналирование. Любое решение по контенту (опубликован, отправлен на ручную проверку, заблокирован) фиксируется в таблицу или базу: дата, источник, результат модерации, краткое пояснение. Многие недооценивают этот шаг, но когда к вам придет вопрос «почему комментарий Х был удален», неплохо иметь историю решения, а не полагаться на память. В российских реалиях журналы — любимая тема регулятора, поэтому Make тут может стать отличным помощником, а не проблемой.

Пятый шаг — уничтожение и отчётность. Данные без согласия или с истекшим сроком хранения должны не просто «теряться», а уничтожаться с фиксированием факта уничтожения. Это можно реализовать таймером в Make: раз в сутки сценарий просматривает таблицу, находит записи с истекшим сроком и запускает удаление с записью в журнал актов. Да, звучит скучно, но когда всё это один раз сделано, оно просто работает в фоне и берет с вас часть риска.

Как Webhook и формы помогают не нарушать принцип минимизации ПДн

Когда я первый раз сталкивалась с модерацией в Make, мне очень хотелось сразу прыгнуть в ИИ-модули и красивые части. Но самый большой эффект на безопасность даёт скучный слой ввода: вебхук и форма. Если форма собирает всё подряд, то потом ни один ИИ-модуль не спасет от избыточности. А если на входе уже аккуратный набор полей, модерация превращается в приятное доведение до ума, а не героическое спасение.

Чтобы показать, что именно стоит проконтролировать в этой части, я свела ключевые элементы в краткий перечень. Здесь важно не запутаться в деталях.

- Правило: собираем только те поля, которые реально нужны для цели (отзыв, заявка, комментарий).

- Правило: на форме явно указываем цель обработки и ссылку на политику ПДн.

- Правило: добавляем отдельный чекбокс согласия на автоматизированную обработку.

- Правило: отправляем в вебхук флаг согласия и версию политики вместе с текстом.

- Правило: не позволяем сценарию продолжаться, если флаг согласия не установлен.

В кейсе с Сашей мы переписали его формы: убрали паспортные данные из отзывов («если вы хотите оставить паспорт, лучше не надо»), спрятали необязательные поля под отдельные чекбоксы, а согласие сформулировали так, чтобы было понятно человеку, а не только юристу. В вебхуке я сделала простую ветку: если нет согласия — логируем факт обращения и мягко завершаем сценарий; если согласие есть — продолжаем обработку и модерацию.

На первый взгляд это выглядит как мелочь, но именно здесь решается судьба всей цепочки. Если на входе уже нарушен принцип минимизации ПДн, модерация дальше будет занимать роль пожарной команды, которая тушит одно и то же здание каждый день. Я бы сказала, что любые сложные сценарии в Make стоит начинать не с OpenAI или ЯндексGPT, а с честного вопроса: какой минимальный объём данных мне реально нужен для этой цели. Это немного дисциплинирует и потом ощутимо облегчает жизнь.

Получается, что аккуратная работа с вебхуком и формами экономит часы и нервы дальше по цепочке. Саша, кстати, после пары недель работы с новой формой стал сам отбрасывать лишние поля на других лендингах, потому что увидел, сколько «мусора» можно не собирать. А модерация Make, как ни странно, только выиграла: меньше шума, больше смысла.

Как встроить ИИ-проверку и не перегнуть с автоматизацией

ИИ-проверка в Make выглядит соблазнительно: подключил ЯндексGPT или GigaChat через HTTP-модуль, написал промпт, получил флажки «норма/не норма». Но здесь у многих начинается перекос: хочется всё отдать на откуп модели и радоваться, что человек больше не нужен. На моей практике это быстро бьет по качеству и по доверию пользователей, а в пограничных историях — по юридическим рискам (хотя формально модель всего лишь предложила решение, а утвердили его вы).

Я заметила, что лучшая конструкция для модерации make ии — это связка «авто + ручная доработка». ИИ ставит предварительный вердикт, а человек либо подтверждает его, либо корректирует, особенно на старте. Чтобы это не превратилось в бесконечные проверки, важно определить уровни доверия к модели и границы, за которые она не заходит. Например, можно разрешить ей автоматически отклонять откровенный спам по жестким шаблонам, но отправлять на ручную проверку любые тексты, где есть ПДн и эмоциональная окраска.

Чтобы зафиксировать для себя типы задач, которые имеет смысл отдавать ИИ в модерации, удобно подсветить ключевую идею.

ИИ хорошо справляется с типовыми, повторяющимися паттернами, но плохо объясняет свои решения на границе допустимого.

В том самом проекте с Сашей мы начали с очень консервативной схемы: модель могла автоматически помечать явный мат и спам (ссылки на мошеннические ресурсы, бессвязный набор символов), но всё, что похоже на негативный отзыв, шло на ручную модерацию. Потом, когда мы накопили статистику, часть зон доверия расширили: например, разрешили ИИ отсекать однотипный «ботный» спам по явным признакам без участия человека.

В промптах для модерации я советую прямо проговаривать, что модель не принимает финальное решение о блокировке, а лишь предлагает флаг. Звучит странно, но работает: текстовые модели начинают выдавать более осторожные, а не категоричные ответы. Мы формулировали что-то вроде: «Оцени текст по шкале токсичности и спама, но не принимай финального решения — только предложи флаг и краткий комментарий». Дальше Make уже решает по своим правилам, что с этим флагом делать.

Получается, что ИИ-проверка — это мощный слой, но только в том случае, если вы оставляете за собой последнее слово и не ленитесь иногда пересматривать логи. Я вначале специально просила Сашу раз в неделю просматривать выборку решений модели и отмечать, где она ошиблась. Это помогло не только подкрутить промпты, но и лучше понять реальную «культуру комментариев» в его аудитории.

Какие инструменты в России помогают дополнить модерацию Make

Одна модерация контента в Make не закроет всё поле требований 152-ФЗ и сопутствующих норм, как бы ни хотелось. Она отлично справляется с обработкой потока: отфильтровать, пометить, направить дальше. Но есть еще слой методологии и учёта, который удобнее отдать специализированным LegalTech-инструментам. В России уже появились решения, которые хорошо стыкуются с автоматизациями и при этом остаются в white-data зоне: PrivacyLine, QForm, 152DOC, DLP-решения типа НОРБИТ.

Когда я собирала материалы для этого текста, я специально смотрела только те сервисы, которые реально работают под российское законодательство, локализованы и не стремятся отправить всё в зарубежное облако. В сочетании с Make они дают ровно то, чего обычно не хватает: реестры процессов, шаблоны согласий, журналы проверок, акты уничтожения. Это те вещи, которые руками делать можно, но через полгода они обычно превращаются в хаос из файлов «итоговый_финальный_точно_последний2».

Чтобы было проще соотнести возможности этих инструментов с потребностями модерации, удобно посмотреть на небольшой фрагмент описания, без погружения в маркетинговые тексты.

PrivacyLine помогает собрать и вести реестры обработки ПДн: какие данные, где хранятся, какая правовая база, кто ответственный.

В кейсах, которые я видела, PrivacyLine реально сокращал время на сбор реестров с недель до пары дней — за счет того, что всё сводится «в одно окно» и дальше уже просто обновляется. Для наших задач это означает, что вы чётко понимаете, где модерация нужна, а где нет, и какие данные в каких цепочках обрабатываются через Make. Не нужно гадать, хранится ли что-то в старой CRM или уже все в новом сервисе.

QForm, в свою очередь, берет на себя журналы и формы. Он хорош, когда нужно автоматизировать обучение по ИБ, фиксировать допуски к ИСПД, вести те самые 11 проверок в год, о которых так любит напоминать РКН. Для модерации это полезно в другом смысле: вы можете в явном виде описать, кто и на каком основании имеет доступ к логам, журналам и результатам AI-проверок, а кто — нет. Многие забывают, что доступ к логам модерации сам по себе может быть обработкой ПДн.

Отдельно стоит упомянуть решения вроде НОРБИТ и 152DOC. Первое специализируется на маскировании ПДн и DLP-функциях: если вы запускаете сложный аналитический ИИ, то он может получать уже обезличенные данные. 152DOC закрывает историю с ОРД: политики, акты уничтожения, учет СКЗИ. Я однажды сидела ночью и заполняла акт уничтожения руками по шаблону из Word, после чего прониклась к таким инструментам почти нежной признательностью (звучит громко, но нервы они экономят).

Получается такая архитектура: Make и модерация контента занимаются оперативкой, а PrivacyLine, QForm и им подобные обеспечивают «скелет» процесса, к которому можно прикладывать автоматизации. Это не конкурирующие, а дополняющие истории. И да, их наличие очень меняет тон разговора с безопасниками и юристами — вдруг становится понятно, что у вас не «кустарное ИИ-решение», а часть выстроенной системы.

Как связать Make с реестрами и журналами без боли

Когда я первый раз предложила связать Make с реестrom в PrivacyLine, проектный менеджер на стороне клиента тихо вздохнул и спросил, нужно ли будет что-то регулярно «перекидывать вручную». К счастью, нет. Большинство подобных инструментов уже умеют принимать данные через API или хотя бы через периодические выгрузки. Make в этом плане выступает как коннектор: берет события, превращает их в аккуратные записи и отправляет дальше.

На практике я делаю так: каждый сценарий модерации в Make имеет «хвост», который пишет событие в журнал. Там фиксируются ключевые атрибуты: дата и время, источник контента, наличие и тип согласия, результат модерации, идентификатор субъекта (по минимуму, без лишнего). Дальше этот журнал либо живет в отдельной таблице с периодическими выгрузками в LegalTech-систему, либо сразу стучится в API реестров, если они это позволяют (хотя сама я пока больше работаю с первым вариантом).

Чтобы показать, какие именно поля я почти всегда включаю в такую запись, удобно отдельно подсветить один из элементов.

Идентификатор записи — это не всегда ФИО или email, чаще это внутренний ID обращения, который позволяет привязать модерацию к событию, не раскрывая лишних ПДн.

В проекте Саши мы реализовали промежуточный вариант. Make записывал логи модерации в Google Sheets, а раз в месяц его помощник выгружал их в формат, удобный для подгрузки в реестр. Это не идеальный, но вполне рабочий компромисс: у вас есть журнал, вы можете показать динамику, вы видите, какие типы контента чаще всего отсеиваются. И да, на базе этих логов мы потом донастраивали ИИ-промпты — оказалось, что часть «подозрительных» текстов на самом деле были странными, но честными вопросами учеников.

Логика связи всегда одна: модерация — это не просто решение «пускать/запрещать», это ещё и данные для улучшения процесса. Если вы логи не сохраняете, вы теряете половину пользы. А если сохраняете, но не стыкуете с общими реестрами ПДн, то в какой-то момент потратите лишние часы на ручную сверку перед проверкой.

В итоге, связка Make с реестрами и журналами не так страшна, как кажется на бумаге. Чаще всего хватает одного-двух дополнительных модулей в сценарии, чтобы ваши решения по модерации перестали быть «мгновенными и забытыми» и превратились в управляемый процесс. Для меня как человека с бэкграундом во внутреннем аудите это прямо бальзам: можно открыть таблицу и увидеть, что именно система делала последний месяц.

Где заканчивается Make и начинается DLP и ИБ

Иногда меня просят «сделать так, чтобы Make сам отслеживал утечки ПДн и блокировал всё, что похоже на нарушение». Тут приходится включать режим скучного взрослого и говорить, что Make — это не DLP-система и не полноценный инструмент ИБ. Он может помочь, но не обязан. Его зона ответственности — оркестрация процессов: получать, маршрутизировать, преобразовывать. Контроль утечек, шифрование, разграничение доступа и прочие радости мира ИБ — это отдельный пласт.

Я поняла, что здесь помогает честно очертить границы возможностей, чтобы не строить из Make то, чем он не является (хотя я сама иногда этим грешила в начале). В области модерации контента в Make можно положиться на него в части маршрутизации, логирования, вызова ИИ-модулей, но нельзя закрыть им все вопросы по защите информации, шифрованию каналов и контролю доступа в принципе.

Чтобы не забывать про это разграничение, я всегда держу в голове одну простую опорную фразу.

Make отвечает за «кто куда пошел и что с ним сделали», а DLP и ИБ-системы — за «кто вообще имел право это видеть и куда это могло утечь».

Если вы строите серьезную систему модерации для крупного бизнеса, у вас почти наверняка будут параллельно жить несколько слоёв: SIEM/СКУД, DLP, средства шифрования, специализированные ИСПД и сверху — оркестрация через Make или аналог. В таком ландшафте модерация в Make — лишь один из потребителей логов и поставщиков событий. Это хорошо, потому что разгружает его от «вселенской ответственности» за безопасность.

В небольшом бизнесе, понятно, таких сложных конструкций нет. Там Make часто становится центральным хабом, через который проходят все события. В этом случае важно хотя бы базово ограничить доступы к самому Make: двухфакторная аутентификация, раздельные роли, отдельные учетки. И не забывать, что токены к ИИ-сервисам и другим провайдерам — это как ключи от сейфа, а не просто строчки в настройках.

Получается, что адекватная модерация контента в Make всегда сидит на стыке: часть задач решает сам Make, часть — внешние сервисы и ИБ-слой. Если принять это как норму, становится проще планировать архитектуру: где нужны серьёзные защиты, а где достаточно аккуратного логирования и минимизации ПДн. На этом фоне возвращаться к конкретным шагам в Make уже не так страшно.

Как это работает на практике: путь Саши от хаоса к нормальной модерации

К этому моменту самое время вернуться к нашему герою. Саша пришёл ко мне с задачей «сделать, чтобы Make сам чистил отзывы и комментарии, а я не думал о Роскомнадзоре». Через пару недель стал говорить уже иначе: «сделать так, чтобы я понимал, что происходит с данными, и тратил на модерацию минут 10 в день». Разница небольшая на слух, но по сути огромная. В этом блоке я разберу, как именно у него выстроился процесс, с какими граблями он столкнулся и чем всё закончилось.

Помнишь про остывший кофе из начала? Так вот, он окончательно остыл к моменту, когда мы в третий раз переписывали текст согласия на сайте, чтобы и юристу было нормально, и пользователи не пугались формулировок. Это нормальное состояние при запуске такой системы: первые итерации почти всегда идут с возвратами, самопоправками и странными инсайтами. Зато потом становится сильно проще жить, потому что нервные места уже пройдены.

Стартовали мы с картины мира: входящие каналы (сайт, Telegram, вебинары), типы контента (отзывы, вопросы, заявки на поддержку), существующие формы и тексты. Первыми шагами были: регистрация в РКН (она у него уже была начата, но не доведена до ума), подготовка политики обработки ПДн и приведение форм в порядок. На всё это ушло около недели, но это была неделя, после которой не возникало желания «прятать голову в песок» при слове «152-ФЗ».

Дальше мы включили Make. Один сценарий принимал отзывы с сайта, второй — сообщения из Telegram-чата, третий — заявки на консультацию. Все они использовали общие куски логики: блок проверки согласия, модуль минимизации ПДн, вызов ИИ-проверки, журналирование. Отличались только источники и конечные точки: публикация в виджете отзывов, отправка модератору, запись в CRM. Мне нравится строить такие сценарии модульно, чтобы при изменении политики не переписывать каждую ветку.

Первый неожиданный эффект: ИИ стал чаще, чем человек, ловить паспорта и ИНН в текстах отзывов. Оказалось, люди действительно любят «подстраховываться» и вписывать туда свои данные, думая, что так повышают доверие. Make с ИИ-модулем автоматически маскировал эти куски, а в журнале мы видели, сколько раз за неделю приходилось это делать. Это был важный разговорный аргумент при обсуждении с командой, зачем вообще так заморачиваться с модерацией.

По мере перестройки процессов Саша всё меньше времени проводил в самих чатах и табличках и всё больше — в интерфейсе модерации, который собрали сверху. Ему достаточно было просмотреть флаги «приграничных» случаев, подтвердить решение и один раз в неделю поглядывать на агрегированную статистику. Ожидание «ИИ всё сделает сам» сменилось более зрелым состоянием «ИИ делает тяжёлую рутину, а я принимаю сложные решения».

Чего не хватило в первой версии и где Make споткнулся

Я бы с удовольствием рассказала, что у нас сработало всё с первого раза, но нет, подожди, есть нюанс. Первая версия модерации в Make была слишком оптимистичной. Мы дали ИИ слишком широкие полномочия по блокировке контента, и он пару раз зарезал вполне невинные, но эмоциональные отзывы. Пользователи начали писать в поддержку с вопросом, почему их комментарий не появился, и Саше пришлось немного тушить этот пожар.

Чтобы не наступать каждый раз на одни и те же грабли, я привыкла анализировать такие сбои по конкретным кусочкам. В нашем случае проблемы были в промптах к ИИ и отсутствии «серой зоны», где ИИ не принимает решение, а только предлагает флаг. Мы слишком сильно доверились модели там, где нужно было оставить человека в цепочке. Исправление заняло пару дней, но вывело модерацию на гораздо более устойчивый режим.

Чтобы зафиксировать, какие симптомы говорят о перегибе с автоматизацией, полезно их коротко обозначить.

Слишком жёсткие правила модерации приводят к тому, что пользователи чувствуют несправедливость и начинают искать обходы или просто уходят.

Мы смягчили промпты, ввели трёхуровневую шкалу решений (авто-публикация, отправка на ручную проверку, авто-блок) и явно ограничили область, где ИИ может действовать самостоятельно. Make стал выполнять больше «мягких маршрутов»: не удалять, а предварительно скрывать и ставить пометку «нужна проверка». Саша, кстати, после этого стал внимательнее относиться к тональности своей собственной коммуникации, потому что увидел, как легко даже алгоритм может воспринять резкий комментарий как токсичный.

Ещё одна деталь, которая всплыла по ходу дела — слабая документация промптов и логики. На первых итерациях мы писали промпты «с налёта», не фиксируя, что именно меняем. Потом, когда понадобилось вернуться на шаг назад, пришлось восстанавливать по памяти. Сейчас я всегда веду небольшой журнал версий: какая формулировка промпта, какие флаги, какие были изменения. Звучит занудно, но когда что-то ломается после правки, этот журнал экономит часы.

Получается, что первая версия модерации в Make почти всегда несовершенна, как бы аккуратно ни планировали. Это не повод отказываться, но хороший аргумент в пользу поэтапного запуска: сначала узкий канал, ограниченный набор контента и обязательно — возможность ручной донастройки. Саша потом благодарил прошлую версию себя, что он согласился на постепенный rollout, а не одним махом на всё сообщество.

Как журналирование и акты спасают в спорах и проверках

Журналы на старте обычно воспринимаются как обуза. Зачем мне ещё одна таблица, если Make и так всё делает? Но ровно до того момента, когда появляется первый спорный случай: клиент утверждает, что его отзыв «исказили», модератор не помнит нюансов, ИИ отзывался по-другому, чем сейчас. В этот момент журналы превращаются из бюрократии в источник правды. Особенно, если они построены аккуратно и последовательно.

Я заметила, что у проектов, которые ведут журналы модерации и акты уничтожения данных, тон общения с проверяющими и партнёрами сильно спокойнее. У вас есть история, вы можете показать, как принимались решения, на основе чего и какой алгоритм действовал. Это снижает уровень домыслов и превращает диалог в разбор конкретных фактов. В России с ее трендом на дистанционный контроль и автоматизированный анализ журналов это вообще становится must-have.

Чтобы не утонуть в теории, я коротко подсвечу один из элементов журналирования, который часто недооценивают, но который сыграл ключевую роль у Саши.

Поле «основание решения» помогает понять, кто фактически принял решение — ИИ, человек или установленное правило, и на что он опирался.

Мы договорились, что каждый лог содержит отметку: auto_ai, manual_moderator или rule_based. В спорных случаях легко было увидеть, это алгоритм погорячился или модератор ошибся. Один раз такой лог спас от долгой переписки с клиентом: ИИ предложил пометить текст как «спорный», модератор подтвердил, и решение оказалось корректным, просто клиент забыл часть собственных формулировок.

Акты уничтожения данных — отдельная песня. В кейсе Саши мы ввели простой сценарий: раз в месяц Make формировал выборку записей, срок хранения которых истёк, удалял их из рабочей базы и записывал факт удаления в отдельный лист. Из этого листа помощник раз в квартал формировал акт по шаблону (как у того же 152DOC), который подшивался к документации. Звучит архаично, но в разговоре с юристом или специалистом по ИБ это производит очень правильное впечатление.

Получается, что журналы и акты — это те самые вещи, которые в момент настройки кажутся лишними, а потом один раз выручают так, что вопрос «зачем мы это делали» перестает возникать. С точки зрения Make это всего пара дополнительных модулей и аккуратная схема полей. С точки зрения устойчивости процесса модерации — фундаментальная опора.

Где чаще всего ошибаются и как не влететь на штрафы

Если бы мне нужно было описать типовой путь ошибки в модерации контента в Make одной фразой, она звучала бы так: «мы включили ИИ, он что-то делает, но никто толком не понимает, что именно и на каких основаниях». Здесь сходятся сразу три риска: правовой (отсутствие согласий и уведомления в РКН), технический (отправка ПДн на внешние сервера без нужных гарантий) и репутационный (некорректная модерация, несправедливые блокировки). Учитывая тренды 2025-2026 годов на усиление дистанционного контроля, такие истории будут всплывать всё чаще.

Я поняла, что удобнее всего говорить об ошибках не в общем, а через конкретные шаблоны поведения. Например, заблуждение «AI сам по себе безопасен» ведёт к тому, что никто не задумывается, куда именно уходят данные и как они возвращаются. Или вера в то, что «мы маленькие, на нас не посмотрят» приводит к отсутствию регистрации как оператора и как следствие — риску штрафов на сотни тысяч рублей за, казалось бы, мелочи.

Чтобы зацепиться за что-то конкретное, я постоянно возвращаюсь к одной мысли, которую повторяю и себе, и клиентам.

Автоматизация не отменяет ответственность, она только делает её быстрее и менее заметной.

В российском поле риски модерации make почти всегда завязаны на ПДн: избыточный сбор, отсутствие согласий, неочевидные передачи третьим лицам, бесконтрольное хранение. Вспомним тот отзыв «Иван Иванов, Москва, паспорт 1234» — без модерации и маскировки он прямой кандидат в инциденты. Если такой отзыв утечет или будет обработан за пределами РФ без необходимых оснований, это уже не просто проблема этики, а вполне материальный штраф.

Отдельный тип ошибок — отсутствие акта уничтожения и логов. Данные в какой-то момент «просто удалили», никто не помнит когда, на каком основании, кто дал команду. В ситуации спора это тяжело защитить. Плюс, с 2026 года с развитием интеграций с ЕСИА вопросы по согласиям и срокам хранения станут ещё более формализованными, так что «авось пронесёт» будет работать всё хуже.

Получается, что чтобы не влететь на штрафы, нужно не столько бояться автоматизации, сколько подходить к ней как к инструменту, который усиливает и дисциплинирует, а не «делает всё за вас». В следующем блоке я соберу практические шаги, которые помогают держать модерацию под контролем и не сгореть на операционке.

Какие заблуждения про ИИ-модерацию особенно опасны

Заблуждения в области ИИ-модерации я уже почти коллекционирую. Они повторяются с завидным постоянством, меняются только формулировки. Самые частые связаны с переоценкой возможностей модели и недооценкой юридической части. Кажется, что если ИИ «умный», он сделает лучше человека, а законы можно подтянуть потом. На практике это работает ровно наоборот: без базовой правовой рамки любые ИИ-сказки достаточно быстро встречаются с протоколом проверки.

На практике чаще всего всплывают такие установки: «ПДн можно анонимизировать на лету, и это уже не ПДн», «если сервер Make не в России, но данные там ненадолго, это не страшно», «согласия на сайте достаточно для всего подряд». Если честно, я где-то в начале пути тоже думала, что анонимизация — это почти магия, пока не почитала методички и не увидела, как аккуратно к ней относятся эксперты.

Чтобы не утонуть в всей этой теории, я буду возвращаться к одной зацепке, которая помогает быстро проверять свою логику.

Если вы не можете простыми словами объяснить клиенту, где обрабатываются его данные и зачем, значит, ИИ-модерация настроена недостаточно прозрачно.

В ИИ-модерации особенно опасна иллюзия того, что модель «сама догадается», что правильно. Она не догадается, она будет следовать тому, как вы построили промпт и окружение. Если вы не прописали, что она не должна сохранять ПДн или пересылать их куда-то ещё, она может сделать это в рамках своих технических настроек. Тут сильно выручает white-data подход: не отправлять лишнее, маскировать до передачи и чётко контролировать каналы.

В кейсе Саши мы зафиксировали список того, чего ИИ точно не делает: не принимает финальные решения об уничтожении, не пишет пользователям напрямую, не меняет тексты отзывов без пометки, что они отредактированы. Звучит очевидно, но когда это лежит в документе, а не в голове, вопросов потом меньше. Один из учеников, кстати, задал вполне резонный вопрос: «а ИИ точно не подменит мой отзыв?». На что Саша смог честно и просто объяснить, как устроен процесс.

Получается, что опаснее всего не технические сбои, а размытые ожидания от ИИ. Если заранее договориться с собой и с командой, что именно он делает и чего не делает, и зафиксировать это в политике и настройках, модерация будет работать намного предсказуемее.

Что делать, если модерация уже крутится, а документов нет

Часто ко мне приходят не на старте, а в момент, когда модерация в Make уже живёт своей жизнью, ИИ проверяет комментарии, а документов под этим почти нет. Это тревожный, но вполне поправимый сценарий. Главное — не впадать в панику и не отключать всё сразу, а стабилизировать ситуацию по шагам. Я в такие моменты мысленно делаю глубокий вдох и достаю блокнот с пометкой «экстренный аудит».

Порядок действий примерно такой: сначала инвентаризация. Нужно понять, какие сценарии в Make обрабатывают ПДн, какие типы данных они трогают и куда дальше отправляют. Потом — фиксация факта: делаем черновой реестр процессов, даже если он пока живёт в таблице. Далее — срочно подтягиваем уведомление в РКН, если его не было, и прописываем хотя бы базовую политику обработки ПДн. И только потом дорабатываем согласия и технические детали модерации.

Я заметила, что такой подход работает лучше, чем попытка «переписать всё за ночь», потому что даёт чувство управляемости. Чтобы помочь себе и читателю удержать структуру, полезно выделить одну опорную мысль.

Лучше признать текущий бардак и начать его описывать, чем делать вид, что модерации «как бы нет» и жить в иллюзии безопасности.

В одном из проектов, очень похожем на кейс Саши, ИИ-модерация работала уже почти год, а документов было примерно ноль. Мы за две недели сделали инвентаризацию, подготовили уведомление в РКН, внедрили новые тексты согласий, добавили журналирование и акты уничтожения. Модерация при этом не останавливалась, просто часть сценариев временно перевели в «щадящий» режим с большим объёмом ручной проверки.

Да, это потребовало дополнительных усилий, но результатом стало не только снижение рисков, но и банальный порядок в данных. Стало понятно, какие типы контента вообще не нуждаются в хранении, а какие стоит агрегировать и анализировать. В итоге из «аварийного исправления» вышел вполне приличный проект по оптимизации процессов.

Получается, что если модерация уже есть, отсутствие документов — это сигнал к действию, а не приговор. Make тут даже помогает: логи и сценарии можно использовать как отправную точку для описания процессов. Просто придётся чуть плотнее посидеть с чаем и блокнотом.

Как превратить модерацию в Make в устойчивую систему, а не разовый проект

На самом деле самая интересная часть истории начинается после того, как первый рабочий прототип модерации уже крутится. В этот момент становится видно, насколько она удобна в повседневной жизни. Люди или начинают ею пользоваться и потихоньку улучшать, или тихо обходят стороной и возвращаются к ручной проверке. Моя цель в таких проектах — сделать так, чтобы модерация ощущалась не как «тугая дверца с кодовым замком», а как нормальная часть рабочего процесса.

Возвращаясь к началу. Помнишь, как Саша не хотел вникать в 152-ФЗ и мечтал, чтобы «всё делалось само»? В финале он честно признался, что рад, что не бросил эту историю на полпути. У него появилась не только рабочая модерация, но и ощущение, что бизнес-процессы стали взрослее. И да, Make перестал быть для него просто конструктором автоматизаций, превратившись в что-то вроде нервной системы его маленькой экосистемы.

Чтобы модерация в Make стала устойчивой, ей нужны три вещи: регулярный пересмотр правил, понятный интерфейс для людей и встроенность в общую логику обработки ПДн. Без этого любые красивые сценарии через полгода превращаются в «легенды старшего разработчика», который один знал, как всё устроено, но уже ушёл на новый проект. В малом бизнесе роль такого разработчика часто исполняет сам владелец, что, честно говоря, не лучший вариант для долгосрочной стабильности.

Я поняла, что комфортная для людей модерация — это та, где интерфейс и правила понятны без лекции от автора системы. Модератор заходит, видит список контента, флаги ИИ, понятные кнопки «опубликовать/отклонить/отправить автору пояснение», а не лезет в Make и не читает сценарии. То же касается и владельца: ему нужна агрегированная статистика по модерации, а не необходимость копаться в логах ради каждого инцидента.

В проектах я всё чаще строю поверх Make дополнительные «витрины» — простые панели на базе Notion, Airtable-аналога или даже обычных таблиц, к которым люди привыкли. Make под капотом гоняет данные, ИИ ставит флаги, а пользователю не нужно знать, как всё это клеится. Звучит как лишний слой, но он сильно повышает шанс того, что модерация проживёт дольше пары месяцев тестов.

Получается, что устойчивость модерации — это не только про техническую надёжность и соответствие закону, но и про человеческую практичность. Если сценарий сложно поддерживать и им неприятно пользоваться, он рано или поздно умрёт. Если же он встроен в рутину и экономит время, люди его берегут и готовы дорабатывать.

Что я бы сразу сделала иначе, зная весь путь

Когда оглядываюсь на свои первые проекты по модерации в Make, местами становится немного смешно. Я тогда пыталась сделать всё слишком идеально и за один заход, вместо того чтобы спокойно разложить на этапы. Иногда хотела удержать в голове сразу и промпты, и реестры, и настройки ИБ, и логи. Сейчас я бы сделала по-другому: начала бы с маленького, но полного цикла на одном канале, а потом расширяла бы на остальные.

Я заметила, что лучший «первый полигон» для модерации — это не самый критичный канал, а тот, где много повторяющегося контента и понятные границы допустимого. Например, отзывы о продукте или комментарии в открытом сообществе. Там проще договориться о правилах, регулировать ошибки и собирать статистику. Уже на ней можно будет строить более сложные сценарии для личных кабинетов или чувствительных обращений.

Чтобы зафиксировать для себя, что именно я бы изменила в подходе, я снова вернулась к одной маленькой, но цепкой фразе.

Лучший момент для сложной автоматизации — после простого, но отлаженного прототипа, а не вместо него.

В кейсе Саши я бы сейчас сделала по-другому стартовую зону доверия к ИИ — дала бы ему меньше прав на авто-блокировку и больше — на подсказки модератору. Но, с другой стороны, именно ошибки первой версии помогли команде прочувствовать границы и научиться разговаривать о модерации не в формате «ИИ дурак», а в формате «мы не так задали ему задачу».

Ещё один момент — документирование. Сейчас я сразу завожу маленький репозиторий знаний по конкретному процессу: схема архитектуры, описание сценариев, версии промптов, шаблоны согласий. Раньше часть этих вещей жила только у меня в голове или в чатах, и при расширении команды это оборачивалось потерей контекста. Да, на старте это кажется лишним усилием, но через пару месяцев благодаришь прошлую себя (и немножко ругаешь, если что-то не описала).

Получается, что идеальных запусков не бывает, и это нормально. Важно не искать магическую формулу, а быть готовой к тому, что первая версия — это черновик, и заложить в систему возможность менять правила без полного сноса конструкции.

Как встроить модерацию Make в общую стратегию автоматизации

Модерация контента — всего один кусочек большой головоломки под названием «автоматизация бизнеса». Если её рассматривать отдельно, она легко начинает казаться избыточной: ещё один сценарий, ещё одна таблица, ещё одна проверка. Но как только смотреть на неё в контексте общей стратегии, пазл начинает сходиться. Модерация помогает удерживать качество входящего потока, снижает шум и защищает от лишних рисков. На её фоне все остальные автоматизации — от рассылок до аналитики — начинают работать стабильнее.

Я всё чаще вижу, как владельцы проектов, познакомившись с модерацией в Make, начинают иначе смотреть на данные в целом. Появляется привычка спрашивать себя: действительно ли мне нужно хранить это поле, а могу ли я убрать часть ПДн до передачи в ИИ, где ещё стоит включить журналы. Здесь Make, n8n и подобные инструменты становятся уже не просто батареей скриптов, а нормальной инфраструктурой, которая экономит время и при этом не ставит бизнес под удар.

Мне самой помогает держать фокус на том, что автоматизация — это в первую очередь про возвращение времени людям, а не про создание сложных схем ради схем. Если модерация в Make экономит десятки минут в день и снижает количество конфликтных ситуаций, она уже окупается, даже не считая юридических рисков. Если при этом она встроена в честное отношение к данным и клиентам, получается редкое и ценное сочетание.

Получается, что модерация — это не узкий технический трюк, а важная часть культуры работы с данными. И да, в России с её 152-ФЗ, РКН, ЕСИА и прочими радостями это особенно ощутимо. В этом смысле модерация в Make — хороший тренажёр: на ней можно отработать дисциплину и прозрачность, а потом переносить эти навыки на другие процессы.

Что в итоге меняется, когда модерация сделана по-человечески

Если попробовать собрать всё сказанное в один живой образ, то модерация контента в Make, сделанная с учётом 152-ФЗ и реальных процессов, превращает хаотичный поток комментариев и заявок в аккуратную реку с понятными берегами. Вода по-прежнему течет, иногда бурлит, но у вас есть шлюзы, фильтры и журналы уровней воды. И главное — все понимают, где эти шлюзы и кто имеет право их крутить.

Вернусь к Саше в последний раз. В итоге он получил систему, в которой Make принимает все входящие отзывы и комментарии, автоматически маскирует лишние ПДн, через ИИ оценивает токсичность и спам, отправляет спорные случаи модератору и ведёт журналы решений. Раз в месяц запускается сценарий уничтожения устаревших данных с формированием акта. На всё это он тратит около 10-15 минут в день, вместо прежнего «плавающего» часа, который ещё и в голове сидел как неприятная обязанность. По моим оценкам, его команда суммарно вернула себе примерно 20-25 часов в месяц, которые раньше уходили в бесконечные чаты и проверки.

Самое заметное изменение было не даже в цифрах, а в ощущениях. Модерация перестала быть чем-то стыдливым и «внутренним», о чем молчат, чтобы не отпугнуть клиентов. Наоборот, он стал открыто писать, что отзывы проходят автоматизированную и ручную проверку, что ПДн маскируются, что данные не уходят за пределы РФ и что у пользователей есть права на доступ и уничтожение. Реакция аудитории была спокойной, без истерик, а некоторые даже отдельно отмечали, что чувствуют себя безопаснее (как бы пафосно это ни звучало).

Если оглянуться на начало текста, где я с остывшим кофе и легкой усталостью говорила про 152-ФЗ и Make, то становится заметна ещё одна штука. Вся эта история про модерацию — не столько про страшные законы, сколько про зрелость процессов. Когда вы можете нарисовать схему, объяснить человеку, где его данные оказываются и зачем, и показать логи реальных решений, между вами и пользователем появляется другое качество доверия. А Make, который когда-то казался просто конструктором для «подключил Telegram к Google Sheets», становится тихим, но очень полезным участником этой картины.

Для тех, кто работает в похожих реалиях — фрилансеры, агентства, небольшие сервисы — мой внутренний вывод простой: модерация в Make не должна быть ни страшной, ни магической. Она вполне управляемая, если идти шаг за шагом, не бояться документов и при этом оставаться живым человеком, который помнит, что по ту сторону сценариев сидят живые пользователи со своими странностями, опечатками и иногда очень длинными отзывами…

А дальше уже дело техники. И чуть-чуть терпения.

Если почувствовала, что хочешь не просто прочитать и закрыть вкладку, а разложить свою модерацию и автоматизации по шагам, можно продолжить это путешествие вместе со мной. На сайте проекты MAREN по автоматизации и AI-оркестрации я собираю свои разборы, схемы и кейсы, которые опираются на ту же логику: прозрачные процессы, честные метрики, white-data подход. Это не теоретические манифесты, а то, с чем я реально работаю руками, адаптируя под российские ограничения и возможности.

Для тех, кто уже крутит n8n, Make, ИИ-агентов и хочет, чтобы они жили не в отрыве от 152-ФЗ, а в мире с ним, особенно полезно иметь под рукой живые примеры. Я время от времени разбираю как раз такие истории: модерация, воронки, интеграции с российскими сервисами, связки с LegalTech. Это не обещание «сделать всё за вас», а приглашение смотреть на автоматизацию как на навык, который можно спокойно осваивать, без истерик и магии. Если тебе откликается такой подход, есть смысл не терять ниточку — дальше будет только интереснее.

Что ещё имеет смысл прояснить перед запуском

Вопрос: Нужно ли регистрироваться в Роскомнадзоре, если через Make обрабатываются только заявки с сайта?

Ответ: Да, в большинстве случаев нужно. Если в заявках есть ФИО, телефон, email, ник в мессенджере или другие идентификаторы, вы уже обрабатываете ПДн с использованием СВТ. Даже если вы маленький фрилансер или учебный проект, формально вы попадаете под требования 152-ФЗ. Разумнее один раз уведомить РКН и выстроить базовые процессы, чем жить в режиме «мы слишком маленькие, нас не заметят».

Вопрос: Можно ли использовать зарубежные ИИ-сервисы для модерации, если данные частично маскируются?

Ответ: Формально многое упирается в то, можно ли однозначно восстановить личность по передаваемым данным. Если вы действительно обезличиваете текст так, что восстановить субъекта нельзя, риски снижаются, но полностью не исчезают. Для российских проектов я рекомендую по возможности использовать локализованные решения и провайдеров с серверами в РФ, чтобы не спорить потом с регулятором о том, где именно обрабатывались ПДн.

Вопрос: Как понять, что ИИ в модерации настроен слишком агрессивно?

Ответ: Первые признаки — жалобы пользователей на «пропадающие» комментарии и ощущение несправедливых блокировок. Второй маркер — большое количество ложных срабатываний в логах, когда модератор регулярно возвращает скрытые сообщения в публикацию. В такой ситуации нужно смягчать промпты, вводить «серую зону» с ручной проверкой и сокращать перечень случаев, когда ИИ может принимать финальное решение.

Вопрос: Что делать, если модерация уже работает, но согласий на автоматизированную обработку нет?

Ответ: Останавливать систему полностью не обязательно, но нужно как можно быстрее подтянуть правовую основу. Сначала проведите инвентаризацию сценариев в Make, затем подготовьте или обновите политику обработки ПДн и уведомление в РКН. После этого перепишите тексты согласий на формах, добавив упоминание автоматизированной обработки, и начните фиксировать новые согласия. Параллельно имеет смысл перевести часть модерации в более щадящий режим с большим участием человека.

Вопрос: Можно ли полностью отказаться от ручной модерации и оставить только ИИ?

Ответ: Я бы не советовала, особенно в российских реалиях и при работе с чувствительным контентом. ИИ отлично справляется с рутиной — очевидным спамом, явной ненормативной лексикой, простыми паттернами нарушений. Но на границе допустимого, где вступают в игру контекст, репутационные риски и тональность, человеку пока нет адекватной замены. Лучше строить гибридную систему, где ИИ делает черновую работу, а человек принимает финальные решения в сложных случаях.

Вопрос: Сколько времени занимает запуск базовой модерации в Make с учётом 152-ФЗ?

Ответ: Если процессы обработки ПДн уже описаны и уведомление в РКН подано, на настройку сценариев в Make и промптов для ИИ обычно уходит от одной до двух недель. Если же всё начинать с нуля, с регистрацией и подготовкой политики, проект может растянуться на месяц-полтора. При этом значительная часть работы делается один раз, а потом только поддерживается и слегка дорабатывается по мере роста проекта.

Метки: ai-agents, makecom, n8n, автоматизация, автопостинг, контент-план