В 2026 оценка RAG-агента перестала быть «чем-то для дата-сайентистов» и стала обычной задачей продуктовой команды. Если не мерить качество ответов и не тестировать логику, вместо помощника получаем уверенного в себе фантазера. В этой статье разберём, как живо и без фанатизма выстроить оценку RAG-агента в реальных сценариях.

Время чтения: 12-14 минут

В начале 2026 я поймала себя на странной статистике: из восьми внедрений только два RAG-агента жили спокойно, остальные стабильно «подвывали» на пользовательских вопросах. Не из-за моделей, а из-за того, что никто не договорился, как мы вообще измеряем качество и где проходит граница «хорошо».

Кофе успевал остыть, пока мы спорили, чей скриншот с ошибкой показательнее. После третьего проекта в PROMAREN я перестала верить на слово «оно вроде отвечает нормально» и стала сначала ставить метрики, а уже потом спорить. Оказалось, что оценка RAG-агента — это не про магию, а про довольно приземлённую дисциплину.

Что такое RAG-агент и чем он отличается от «просто бота»

3 из 5 команд в РФ в 2026 называют RAG-агентом любого бота с базой документов, но это сильно упрощает картину. От точного определения зависит, что именно вы будете оценивать и где искать ошибки.

RAG-агент — это связка поиска по вашим данным (retrieval) и генерации ответа (generation), которая подхватывает найденные фрагменты и складывает из них осмысленный текст. То есть это не просто нейронная сеть, а рабочий ансамбль: векторный поиск, ранжирование, модели вроде YandexGPT или GigaChat и обвязка вокруг них. ChatGPT без доступа к вашей базе здесь вообще ни при чем — он живет на своих знаниях, а не на ваших.

Как сейчас устроен типовой RAG-агент

Если разложить агента по шагам, получается вполне человеческая логика: сначала он пытается понять вопрос, потом ищет релевантные кусочки данных, а уже после формулирует ответ. В 2026 это практически всегда история не только про документы, но и про инструменты — API, базы, поисковые движки.

Представь HR-ассистента в крупной компании: сотрудник спрашивает, как оформить отпуск. Агент на базе YandexGPT сначала вытаскивает из векторного индекса несколько чанков из положения о отпусках и FAQ по кадрам, потом прогоняет их через reranker, а затем генерирует ответ с ссылками на конкретные пункты. Без retrieval он был бы тем же ChatGPT с усреднёнными советами и рисками по 152-ФЗ, а так работает как живой «кадровик в мессенджере».

Почему определение критично для оценки

Это критично, потому что если вы не разделяете поиск и генерацию, то и оценка RAG-агента превращается в кашу: непонятно, кого ругать — поиск или модель. Я раньше честно пыталась «оценить ответ в целом», пока не увидела, что одни и те же чаты ругают за противоположные вещи — то не нашел документ, то нашел, но сказал глупость.

Сейчас в PROMAREN мы всегда рисуем пайплайн на доске: запрос, преобразование, поиск, реранкинг, генерация, пост-обработка. На каждом шаге можно повесить свои метрики: recall по документам, faithfulness ответа, задержку, стоимость. Такой разбор снимает 80% эмоциональных споров «мне кажется, агент тупит» и переводит разговор в плоскость цифр. Дальше уже можно говорить о метриках.

Где RAG-агент особенно полезен в РФ-контексте

В 2025-2026 в РФ RAG-агенты особенно хорошо заходят там, где много документов и часто меняются правила: финансы, HR, юристы, внутренний аудит. У нас одновременно требования по 152-ФЗ, внутренние регламенты, локальные AI-платформы — и человек не успевает всё перелопачивать вручную.

В одном из проектов PROMAREN мы поднимали RAG-агента поверх базы внутренних политик и отчётов: YandexGPT Pro как модель, свой векторный индекс, обновление документов раз в ночь. Раньше аудиторы листали PDF по полчаса, теперь тратят 3-4 минуты, потому что агент не только отвечает, но и показывает, из какого отчёта взят факт. Стоп, а как понять, что он действительно не врёт — перейдём к метрикам.

Как работают метрики RAG и зачем их делить на уровни

3 из 5 RAG-агентов в РФ буксуют на цитировании — ответы есть, а пруфов нет. Это значит, что метрики либо не настроены, либо смотрят не туда, и ретривер с генерацией мешают в один котел.

Метрики RAG всегда живут в двух слоях: для retrieval и для generation. На уровне поиска мы отвечаем на вопрос «нашли ли мы вообще нужные документы», а на уровне генерации — «сказал ли агент правду и по теме». Если первый слой хромает, никакой YandexGPT не спасёт, он просто красиво перескажет мусор. Если второй слабый, у вас идеальные чанки, но галлюцинации в ответах.

Метрики поиска: recall, precision и их друзья

Для retrieval в 2026 по-прежнему важны старые добрые recall@k, precision@k и nDCG: они отвечают, сколько нужных документов попало в топ и насколько разумно они отсортированы. Да, это скучные цифры, но без них impossible понять, что у вас вообще ломается — индекс, эмбеддинги или логика запроса.

По данным нескольких проектов PROMAREN, если recall@5 по тестовому набору падает ниже 0.7, пользователи начинают жаловаться «бот не в курсе наших документов», даже если генерация местами блестящая. Один раз мы поймали ситуацию, когда BM25 работал лучше векторного поиска, потому что юристы писали запросы почти цитатами из договоров. Мы просто включили гибридный поиск и подняли recall на 20% без смены модели.

Метрики ответа: faithfulness и relevance в практическом виде

На уровне генерации нас уже не интересует, какие документы нашлись — только то, что сказал агент. Здесь на первый план в тестировании ИИ выходят метрики faithfulness (насколько ответ следует контексту) и answer relevance (насколько он вообще отвечает на вопрос). В 2026 это удобнее всего мерить через RAGAS или похожие фреймворки.

RAGAS смотрит на связку «вопрос — контекст — ответ» и выдает набор оценок от 0 до 1. В одном из кейсов у нас faithfulness держался на уровне 0.6: агент красиво рассуждал, но постоянно «дорисовывал» условия в договорах. После того как мы добавили реранкинг через cross-encoder и урезали длину контекста, показатель вырос до 0.9, а количество жалоб на «путает формулировки» почти сошло на нет. Это означает, что правильные документы — только половина успеха.

Почему старые метрики вроде BLEU здесь не работают

Раньше я на автомате тянулась к BLEU и ROUGE — по привычке из мира машинного перевода. Но для RAG-агентов в 2026 они скорее мешают, чем помогают: сравнивать ответ с эталонным по совпадению слов бессмысленно, если пользователь может задать вопрос тысячью формулировок, а правильных ответов несколько.

Сейчас лучше работает подход «смысловой близости»: мы используем LLM-as-a-judge или специализированные метрики смыслового совпадения, которые смотрят не на слова, а на факты. По сути, одна модель (часто другая, чем в проде) проверяет ответ агента и решает, соответствует ли он истине. У этого тоже есть свои грабли, но как слой автоматической фильтрации перед ручной проверкой это сильно экономит время. Дальше останется выбрать, какие именно метрики будут жить в вашем пайплайне.

Какие метрики для тестирования ИИ выбирать в 2026

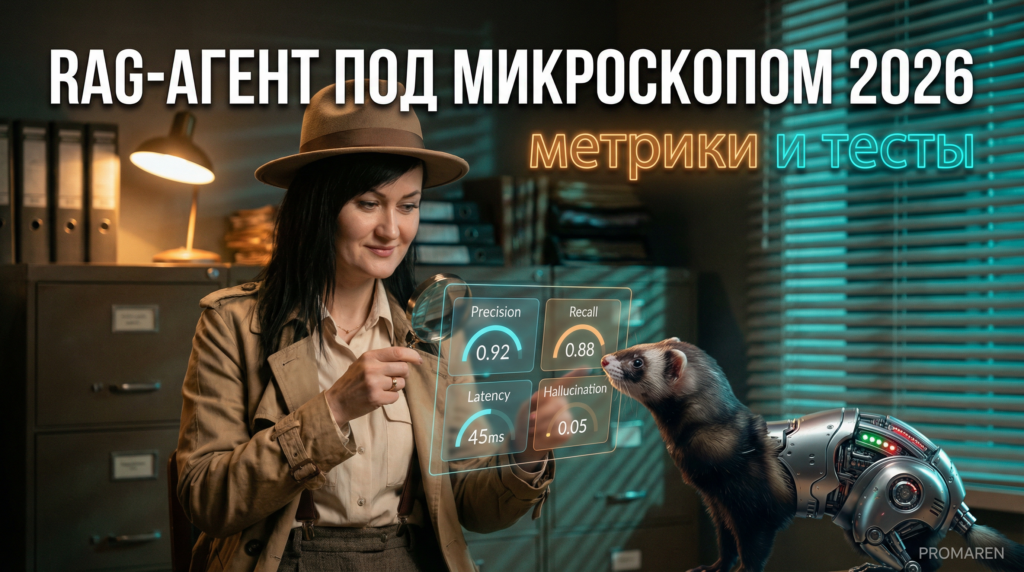

В 2026 оценка RAG-агента, если не усложнять, сводится к комбинации из 4-6 метрик: две-три про качество, одна-две про скорость и стоимость, плюс немного ручной проверки. Этого достаточно, чтобы понять, можно ли выпускать агента к людям.

Я заметила, что самый частый перекос — меряют только качество текста и совершенно игнорируют латентность и цену токенов. В итоге на демо все красиво, а в бою запросы ждут по 15 секунд и жгут бюджет. Поэтому для промышленных сценариев в PROMAREN мы всегда ставим рядом метрики надёжности и метрики производительности.

Базовый набор метрик для реальных проектов

На практике хорошо работает такой минимальный набор: faithfulness и answer correctness из RAGAS, context precision (насколько релевантен контекст), latency (время ответа) и стоимость запроса в токенах или рублях. Это уже даёт картинку, где именно агент страдает и чего пользователи ощущают как «некомфортно».

В одном проекте по поддержке клиентов мы собрали датасет из 400 реальных вопросов из логов и прогнали через пайплайн. До доработок faithfulness был 0.72, среднее время ответа — 6.5 секунды. После настройки гибридного поиска, сжатия контекста и оптимизации запросов к YandexGPT мы вышли на 0.88 и 2.1 секунды. Пользовательские жалобы на «долго отвечает» почти исчезли, а SLA уложился в требования бизнеса.

Как выглядит сценарий тестирования RAG-агента

Чтобы тестирование RAG не превратилось в бесконечный экспериментальный полигон, я придерживаюсь простой схемы, без фанатизма в математике. Сначала мы собираем репрезентативный набор вопросов: минимум 100, лучше 300-500, из реальных логов, а не фантазий. Потом запускаем агент, сохраняем найденные чанки и ответы — и уже поверх этого считаем метрики.

Здесь работает логика: тестовый прогон — RAGAS или аналог — автоматический отчёт — выборка «подозрительных» кейсов на ручную проверку. Обычно это те, где оценки ниже 0.8 или LLM-as-a-judge ставит пометку «hallucination». Такой подход сочетает тестирование нейронных сетей и человеческий здоровый смысл. Честно, без ручной выборки всё равно никуда, особенно в чувствительных доменах вроде юристов или комплаенса.

Инструменты для тестирования ИИ-решений в 2026

По состоянию на начало 2026 основной стек выглядит довольно приземлённо: RAGAS как open-source фреймворк, LangChain или LlamaIndex для обвязки, Yandex Cloud или VK Cloud как инфраструктура. Поверх этого можно вешать мониторинг через Prometheus и дашборды в Grafana, а для продвинутого отслеживания экспериментов — аналоги Weights&Biases, пусть и через VPN.

Я использую автоматизацию через n8n, чтобы гонять ночные тесты RAG-агентов по расписанию: сценарий забирает свежие логи, прогоняет их через пайплайн, считает метрики и складывает отчёт в Notion. На сайте PROMAREN есть материалы про такую автоматизацию тестов RAG, если интересно посмотреть архитектуру. Дальше начинается самая скучная часть, которую обычно никто не любит — системное тестирование и обновление.

Почему без регулярного тестирования RAG всё ломается через 3 месяца

Тут я поняла одну неприятную вещь: даже идеально настроенный RAG-агент в феврале 2026 к маю начинает «подтупливать», если его не трогать. Не потому что модель испортилась, а потому что мир вокруг поменялся, а база не успела.

Бизнес-процессы переписывают регламенты, выходит новый релиз продукта, меняются цены, обновляется законодательство — а агент продолжает цитировать старые PDF как истину. Без регулярного тестирования ИИ и обновления индекса метрики начинают незаметно ползти вниз: сначала faithfulness с 0.9 до 0.82, потом до 0.75. Пользователи это чувствуют раньше всех, но редко сразу приходят с цифрами.

Типовые проблемы RAG без тестирования

По опыту PROMAREN за 2025-2026 типичные грабли всегда одни и те же: плохой чанкинг, отсутствие реранкинга, устаревшая база и отсутствие контроля лимита контекста. Если куски слишком большие, важные факты размазываются, и ретривер их просто не видит. Если не использовать reranker, в топ попадают полубессмысленные документы, и модель уже ничего не спасет.

Ещё одна боль — перегруженный контекст: разработчики, боясь «чего-то не упустить», пихают в запрос 10-15 чанков, пока не упрёмся в лимит токенов. В итоге ответ получается общим, расплывчатым и иногда вообще о другом. По данным одного внутреннего аудита, когда мы ограничили контекст до 4-5 тщательно отобранных чанков, доля точных ответов по RAGAS выросла на 12 процентных пунктов без смены модели.

Как встроить проверку качества ответов в повседневную жизнь

Проверка качества ответов RAG-агента работает только тогда, когда она встроена в процессы, а не живет в отдельной «папке для релизов». Сейчас у нас хорошо прижился подход с двумя контурами: автоматический мониторинг и «живой» канал обратной связи от пользователей.

Автоматизация выглядит так: ночные тесты по фиксированному набору запросов, сравнение метрик с эталоном, алёрты, если faithfulness или context precision падают ниже порога. Пользовательский контур — это кнопка «плохой ответ» в интерфейсе и разбор таких кейсов раз в неделю. На основе этого мы переобучаем индексы, пересобираем датасеты и подтягиваем сценарии. На сайте PROMAREN я подробно расписывала подобные контуры качества.

Здесь работает привычный набор инженерных привычек

Здесь работает банальное, но почему-то редкое: версионирование источников, журнал изменений и связь релизов регламентов с пересборкой индекса. Я раньше думала, что можно «один раз хорошо настроить», а дальше только чуть-чуть шлифовать, но после трёх проектов в быстрых отраслях поняла, что это иллюзия.

Главное правило: все изменения в базе знаний и логике агентов должны быть прозрачно связаны с тестами и метриками. Если юристы меняют шаблон договора, в тот же спринт влетает задача на обновление данных и ночные тесты. Да, звучит скучно, зато потом не приходится объяснять руководству, почему агент уверенно советует старые штрафы и сроки. Отсюда логично перейти к вопросу доверия.

Можно ли доверять RAG-агентам и где проходит граница

Доверять RAG-агентам можно, но только тем, у кого есть паспорт с метриками и история медосмотров. В 2026 я не выпускаю ни одного рабочего агента без минимального набора цифр по качеству и понятной схемы, кто и как за ним смотрит.

Если агент крутится в зонах с рисками — финансы, юристы, аудит — доверие всегда условное: он подсказывает, а не принимает решение. Но даже в «лайтовых» сценариях вроде внутреннего поиска по документам без оценки RAG-агента вы рискуете посадить людей на красивый, но не очень честный инструмент. Тут лучше лишний раз перестраховаться.

Как понять, что агенту уже можно доверять

Я для себя держу простый порог: для чувствительных сценариев средний faithfulness и answer correctness выше 0.85, жалоб от пользователей на «соврал» меньше 5-10% от всех обращений, а критические ошибки за месяц можно пересчитать по пальцам одной руки. Это не идеал, но рабочий компромисс между риском и пользой.

В одном юридическом проекте мы запускали RAG-ассистента по договорам. На пилоте у него было около 60% доверия юристов: они перепроверяли всё. После трёх итераций тестирования и тюнинга, когда метрики по RAGAS стабильно держались выше 0.9 и мы ввели guardrails на опасные советы, команда уже автоматически использовала ответы агента как черновик. Экономия вышла около 500 часов в месяц, но главное — юристы перестали чувствовать, что их подставляют.

Что делать, чтобы агент не превратился в «чёрный ящик»

Самый частый страх в 2026 — не в том, что агент ошибётся, а в том, что непонятно, почему он это сделал. Здесь помогают очень приземлённые вещи: ссылки на источники, явное цитирование, логирование всех шагов цепочки. Когда пользователь может открыть документ, на который ссылается ответ, уровень стресса резко падает.

На практике я всегда прошу разработчиков показывать не только текст, но и список чанков, которые легли в основу ответа, пусть даже в «режиме для любопытных». Это убирает эффект магии и делает RAG-агента частью прозрачного процесса. В разборе кейсов на канале PROMAREN я регулярно показываю такие «подкапотные» скрины — люди сразу иначе воспринимают систему.

Где граница между доверием и автоматизацией решений

Я бы смотрела на это так: пока речь идёт об информации, подсказках, черновиках документов и поиске по базам — RAG-агент может быть почти самостоятельным, с редкими выборочными проверками. Как только начинаются действия с юридическими или финансовыми последствиями, включается принцип «двух ключей»: агент предлагает, человек утверждает.

Я раньше думала, что можно «натренировать до идеала» и забыть, но после нескольких проверок и диалогов с комплаенсом поняла, что идеал в живом бизнесе не нужен. Нужны понятные метрики, честная архитектура под 152-ФЗ и договоренность, кто в каких зонах несет ответственность. С этим можно жить спокойно и строить дальше, а если хочется углубиться, я отдельно разбираю такие схемы в системе ботов для telegram канала на странице про чат-боты PROMAREN.

Куда смотреть, если хочется меньше хаоса в оценке RAG

Когда смотришь на все эти метрики и тесты сразу, легко почувствовать лёгкую усталость: как это всё держать в голове и не утонуть. Но если разложить шаги, картина получается довольно спокойной.

Получается, для живого RAG-агента в 2026 важны три вещи: аккуратно разделить поиск и генерацию, договориться про 4-6 опорных метрик (качество, скорость, стоимость) и встроить регулярные тесты в обычный рабочий ритм. Без этого даже красивый пилот превращается в источник ошибок и недоверия, а с этим агент спокойно становится частью команды, а не игрушкой для демо.

Обо мне. Я — Марина Погодина, основательница PROMAREN и AI Governance & Automation Lead, раньше работала во внутреннем аудите и ИТ-рисках. С 2024 года помогаю командам в РФ строить white-data RAG-системы и агентов под 152-ФЗ, о чём пишу в статьях про AI-инструменты и делюсь кейсами в канале PROMAREN.

Если хочется разобрать собственный кейс или посмотреть, как оценка RAG-агента и автоматизация тестов могут работать в живом процессе, загляни в «тестовый доступ» к нашему боту PROMAREN Контент-завод. Для тех, кому ближе архитектуры и схемы, на сайте PROMAREN лежат подробные разборы связок с n8n и Make.

Что ещё важно знать про оценку RAG-агентов

А если у меня нет ресурсов на сложные метрики, что делать

Можно начать с простого: взять 100-150 реальных вопросов, прогнать через агента и вручную пометить ответы как «верный», «частично» или «ошибка». Такой ручной срез уже даёт базовый процент качества и показывает типовые сбои. Потом, когда станет понятно, что болит чаще всего, можно добавить одну-две автоматические метрики вроде faithfulness и latency и постепенно обрастать инструментами.

Можно ли обойтись без RAGAS и считать всё своими силами

Можно, но придётся заново изобрести то, что уже хорошо собрано в готовом фреймворке. RAGAS даёт удобную структуру: отдельные оценки за контекст, релевантность и корректность, плюс формат отчётов. Если ресурсов на интеграцию нет, можно использовать идею: делать срез по тем же критериям, но в виде таблицы в Excel или Notion. Главное — стабильность подхода, а не конкретный инструмент.

Что делать, когда метрики хорошие, а пользователи всё равно недовольны

Такое бывает, когда метрики смотрят на «фактическую правильность», а пользователи — на удобство и тон. Ответ может быть точным, но слишком длинным, сухим или техническим для аудитории. В таких случаях полезно добавить пользовательские опросы, наблюдение за сессиями и метрики вовлеченности (дочитывания, повторные вопросы). Это помогает совместить «арифметически хороший» RAG с живым опытом людей.

Можно ли тестировать RAG-агента только на синтетических данных

Чисто теоретически да, но на практике картина получится искажённой. Синтетические запросы, сгенерированные нейросетью, часто аккуратнее и структурированнее, чем реальные вопросы пользователей, поэтому метрики будут завышены. Оптимальный вариант — смешанный датасет: часть настоящих логов, часть синтетики под редкие или опасные сценарии. Так вы проверите и типичное поведение, и крайние случаи.

Когда пора пересматривать метрики и тестовый набор

Точно пора, если бизнес-процессы сильно изменились, добавились новые виды запросов или вы заметили рост жалоб при вроде бы стабильных цифрах. Ещё один сигнал — когда команда начинает игнорировать отчёты, потому что они больше не отражают реальность. Я советую раз в квартал пересматривать датасет и набор метрик: что-то убирать как устаревшее, что-то добавлять под новые сценарии, чтобы оценка оставалась живой.