152-ФЗ и нейросети: где бизнес нарушает закон

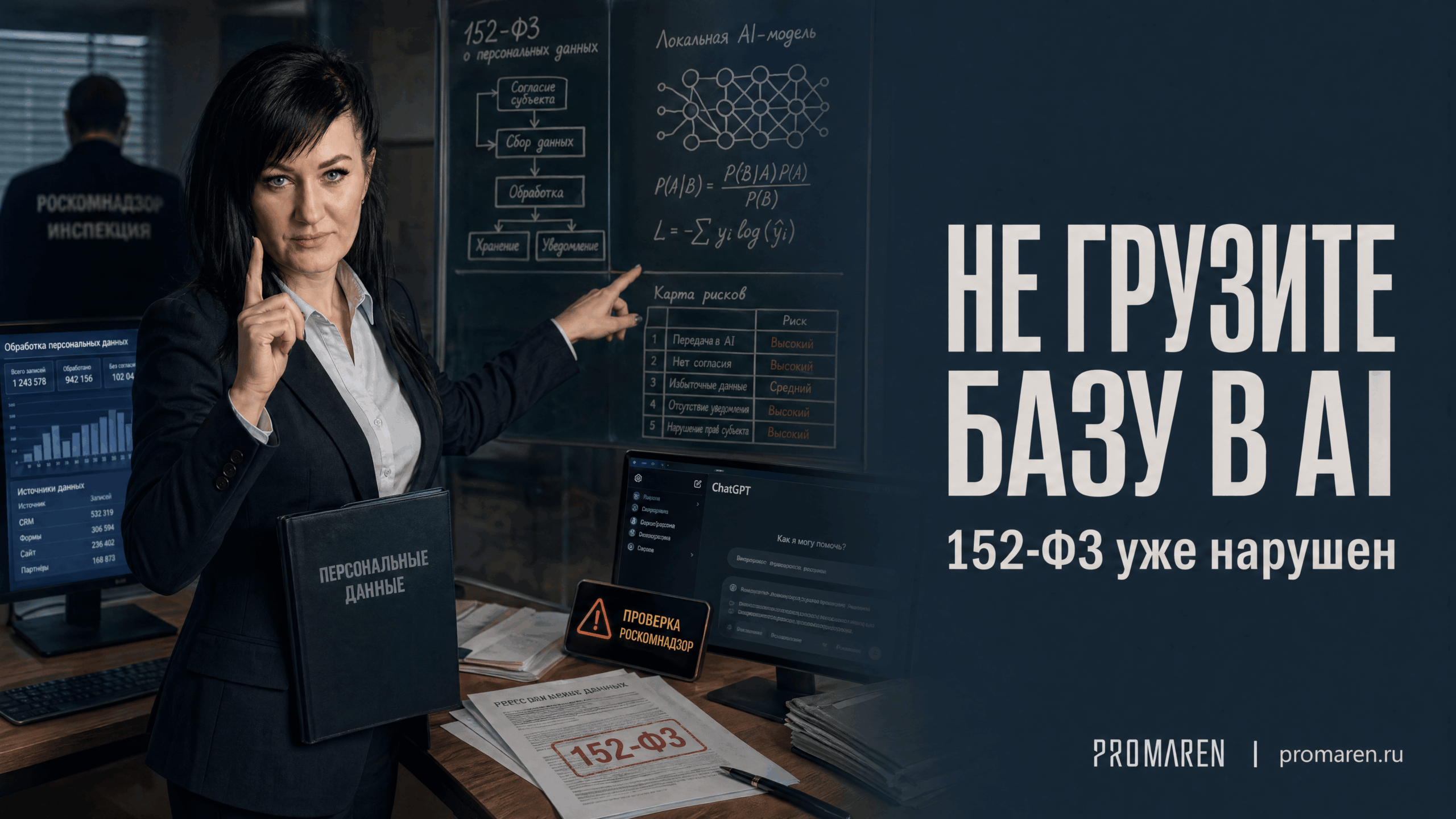

152-фз нейросети — сочетание, на котором бизнес сгорает быстрее, чем успевает написать первый промпт. Вы загрузили базу клиентов в ChatGPT для рассылки и получили риск нарушения закона о персональных данных, претензий Роскомнадзора и проблем с трансграничной передачей.

Время чтения: 13 минут

152-фз нейросети требуют проверки до запуска, а не после инцидента. Один неверный сценарий с клиентской базой, резюме кандидатов или перепиской поддержки может превратить удобный AI-сервис в юридический и операционный риск.

Все учат сначала подключать ИИ. Я 16 лет в аудите говорю: порядок обратный. Сначала нужно понять, какие данные реально двигаются по процессу, где возникает обработка ПДн, кто оператор, кто обработчик и в какой момент появляется трансграничная передача. Уже после этого выбирают сервис, архитектуру и договорную обвязку.

Когда я разбираю такие внедрения для бизнеса, смотрю не на красивое демо, а на схему движения данных. В проектах уровня крупных компаний вроде МТС, X5 или авиации ошибка почти никогда не начинается с модели. Она начинается с процесса: менеджер выгрузил CSV, маркетолог вставил список в облачный сервис, юристы узнали об этом последними.

152-ФЗ и нейросети пересекаются в момент, когда AI-сервис получает данные, по которым можно прямо или косвенно определить человека. Если сервис хранит, анализирует, использует для обучения или передаёт такие данные дальше, у бизнеса возникает обязанность проверить правовое основание, контур обработки и маршруты передачи.

Можно ли загружать персональные данные в нейросеть

Персональные данные — это любая информация, которая прямо или косвенно относится к определённому человеку. Для бизнеса вопрос звучит не как «можно ли использовать AI», а как «какие именно данные, на каком основании и в какой среде вы отправляете в модель».

Ответ для руководителя простой: иногда можно, часто нельзя без предварительной проверки, а в публичный облачный сервис без анализа рисков загружать клиентские базы, резюме, обращения поддержки и медицинские или HR-данные опасно. Если в строке есть ФИО, телефон, e-mail, адрес, номер договора, история покупок, IP, запись разговора или биометрические данные, это уже зона закона о персональных данных.

Где бизнес ошибается в первый день

Самый частый сценарий в 2025 году: отдел маркетинга хочет быстрее сделать рассылку и выгружает 20 000 контактов в ChatGPT, чтобы сегментировать аудиторию. Задача бизнесовая понятна — увеличить конверсию. Юридический риск тоже понятен: вы передали ПДн внешнему сервису, а потом пытаетесь задним числом объяснить, на каком основании это сделали.

Второй сценарий я вижу у HR-команд. Рекрутер отправляет в нейросеть 300 резюме, чтобы получить рейтинг кандидатов. Там есть телефоны, почта, возраст, опыт, иногда семейное положение. Даже если цель законная, сам способ обработки может нарушать согласие на обработку, политику конфиденциальности и внутренний регламент доступа.

Когда без согласия уже тонко

Фраза «мы же просто анализируем» не спасает. Если AI участвует в обработке пдн, вы должны проверить правовое основание, цель обработки и объём данных. Для части процессов основанием может быть договор или законный интерес, но для передачи данных третьим лицам и особенно во внешний сервис этого часто недостаточно.

Нужно ли согласие на обработку данных для AI, зависит от сценария. Если вы используете обезличивание до передачи и не можете восстановить личность без отдельного контура, риски ниже. Если же отправляете исходные данные в сервис, который может хранить их, использовать для улучшения моделей или обрабатывать вне РФ, согласие и отдельная правовая оценка уже не формальность. Дальше логично перейти к главному источнику риска — самому облачному сервису.

Почему ChatGPT может нарушать 152-ФЗ

В марте 2026 я снова видела одну и ту же ошибку: компания считает, что проблема в названии сервиса. На практике проблема в том, что ChatGPT и аналогичные инструменты часто оказываются внешним обработчиком данных, а бизнес не понимает, что именно уходит за пределы его контура.

Облачные AI-сервисы удобны и быстры. Для ПДн критичны другие параметры: где физически хранятся данные, кто получает доступ, есть ли локализация данных, можно ли отключить обучение на пользовательских запросах, как прописаны условия в договоре и политике сервиса. Если этого контроля нет, вопрос «можно ли использовать ChatGPT» превращается в вопрос «готовы ли вы принять нарушение и потом объясняться с регулятором».

Трансграничная передача возникает раньше, чем думают

Трансграничная передача — это передача персональных данных на территорию иностранного государства или иностранному лицу. Для многих AI-сервисов это не исключение, а стандартная архитектура. Менеджер сидит в Москве, вставляет текст в браузер, а обработка идёт через зарубежную инфраструктуру. Фактически риск уже возник.

В 2025 году тема стала жёстче из-за усиления контроля и роста штрафов. По материалам о поправках, вступивших в силу с 30 мая 2025 года, ответственность за нарушения в сфере ПДн усилилась, а интерес к реальной схеме обработки вырос на уровне деловой практики и правоприменения. Для бизнеса это означает простую вещь: период, когда можно было сослаться на незнание, закончился.

Обезличивание работает только если оно настоящее

Компании часто говорят, что передают в модель обезличенные данные. Потом выясняется, что в тексте остались номер заказа, редкий адрес доставки, название работодателя и дата события. По отдельности куски выглядят безопасно, вместе позволяют определить человека. Такой «полумаскинг» не даёт надёжной защиты.

- Регулярные выражения помогают убрать очевидные поля вроде телефона или e-mail, но пропускают контекст.

- NER-модели распознают сущности: имена, адреса, даты, компании, номера документов.

- LLM для маскировки могут дополнительно чистить свободный текст, где ПДн спрятаны в описании.

- Проверка человеком нужна на пилоте, иначе ложное чувство безопасности стоит дороже часа аудита.

Именно поэтому я строю разбор не от ТЗ, а от бизнес-цели и маршрута данных. Сервис может быть удобным, но несоответствующим. Следующий вопрос тогда звучит технически: как понять, что AI и Роскомнадзор в вашем процессе уже движутся навстречу друг другу.

Как понять, что AI-сервис нарушает 152-ФЗ

Если сервис не раскрывает, где и как обрабатывает данные, считайте это красным флагом до доказательства обратного. Проверка AI-сервиса на соответствие 152-ФЗ начинается с документов, но заканчивается архитектурой, логами, ролями доступа и фактическим движением данных.

В проектах PROMAREN я обычно смотрю 5 слоёв: интерфейс, API, хранилище, договоры и внутренний контроль. На уровне интерфейса менеджер видит просто окно чата. На уровне аудита видно, что запрос уходит третьей стороне, сохраняется в истории, копируется в CRM и попадает в аналитику. Именно на таких стыках процесс ломается.

Чек по сервису занимает 30-60 минут, если знать что искать

Проверять нужно не только сайт поставщика, но и вашу собственную схему. В одной компании продажники вручную вставляли обращения клиентов в внешний AI. Формально «интеграции» не было. По факту обработка персональных данных шла каждый день, просто без договорной и технической фиксации.

Если сотрудник может вставить реальные ПДн в сервис без запрета, логирования и регламента, у вас уже есть комплаенс-разрыв. Это вопрос не только юристов, но и внутреннего контроля, которым в больших структурах вроде PwC, Deloitte или ЦБ РФ всегда занимались заранее, а не после жалобы.

Что смотреть в первую очередь

Начните с короткого списка признаков. Он даёт быстрый ответ, как использовать AI и не нарушить 152-фз.

- Проверьте, описан ли статус сервиса в договоре: кто оператор, кто обработчик, кто отвечает за инциденты.

- Сверьте политику конфиденциальности с реальным сценарием: хранение, обучение модели, субподрядчики, срок удаления.

- Уточните, где расположены серверы и возникает ли локализация данных только на бумаге.

- Посмотрите, можно ли отключить сохранение запросов и доступ сотрудников вендора к истории.

- Оцените, какие типы данных туда вообще попадают: обычные ПДн, чувствительные, кадровые, платёжные.

- Проверьте, есть ли у вас согласие на обработку и передачу в таком объёме, если оно требуется.

Когда по 2-3 пунктам уже нет чёткого ответа, решение должно быть консервативным: не отправлять данные до прояснения. После диагностики остаётся вопрос последствий. Именно он обычно заставляет совет директоров слушать внимательнее.

Перед внедрением проведите трёхслойную проверку: правовое основание, маршрут данных и настройки доступа. Такой аудит занимает 3-5 дней и экономит месяцы на переделку, ответы Роскомнадзору и экстренное переписывание процессов.

Какие риски для бизнеса при работе с нейросетями

Риск здесь многослойный: штрафы, инциденты, искажение процессов и потеря управляемости. Бизнес часто считает только прямой штраф, хотя реальные потери возникают из 4 источников сразу: юридический блок, репутация, переделка процессов и простой команды.

Сценарий «что будет если передать персональные данные нейросети» обычно развивается по одной из трёх веток. Первая — регуляторный вопрос после жалобы или проверки. Вторая — внутренняя утечка через историю чатов, экспорт логов или доступ подрядчика. Третья — незаметная деградация процесса, когда сотрудники массово используют сервис в обход правил, а руководство узнаёт об этом на инциденте.

Деньги теряются не в момент штрафа

Было: менеджеры за 2 часа в день вручную готовили тексты ответов клиентам и искали быстрый AI-инструмент. Стало после непродуманного внедрения: 1 инцидент, срочный разбор, остановка процесса на 2 недели, юристы, ИБ и маркетинг заняты тушением пожара вместо продаж. Такие истории я видела в компаниях разного масштаба, и закономерность одна: дешевле было один раз сделать оценку рисков.

Отдельный риск связан с договорами и подрядчиками. Если AI-сервис передаёт данные дальше или использует стороннюю инфраструктуру без прозрачных условий, вы можете не понимать полный круг лиц, которые участвуют в обработке. Для Роскомнадзора и для суда аргумент «мы думали, это просто интерфейс» слабый.

Репутация бьёт дольше штрафа

В апреле 2026 бизнес уже лучше понимает стоимость инцидента с ПДн. Клиент может простить задержку ответа, но плохо прощает ситуацию, когда его данные ушли в непонятный сервис ради удобства команды. Особенно это чувствительно в медицине, финансах, образовании и B2B с длинными контрактами.

Поэтому 152-фз нейросети нужно обсуждать на уровне руководителя функции, ИТ и юриста одновременно. В крупных экосистемах вроде Аэрофлота или X5 такой разговор давно не сводится к вопросу «какую модель купить». Сначала считают риск, потом проектируют контур, потом запускают пилот. Из этого естественно вытекает следующий тезис: когда локальная модель действительно безопаснее публичного облака.

Чем безопаснее локальная AI-модель для персональных данных

Больше технологий не дают больше безопасности. Для ПДн часто безопаснее более скучное решение: локальная AI-модель, закрытый контур или кодовый сценарий с минимальной передачей данных наружу.

Локальная модель снижает риск там, где вы контролируете инфраструктуру, доступы, журналирование и срок хранения. Она не делает проект автоматически законным, но резко уменьшает число неизвестных. Если обработка идёт внутри вашего периметра, проще обеспечить локализацию данных, проверить роли, встроить обезличивание и ограничить экспорт исходных текстов.

Когда локальный вариант оправдан

Если вы работаете с клиентской базой, кадровым контуром, обращениями поддержки, договорами, медицинскими или финансовыми данными, локальный или кодовый вариант часто разумнее публичного AI-сервиса. Скорость запуска может быть ниже на 2-6 недель. Зато вы не строите бизнес-процесс на чужих правилах, которые могут меняться без вашего согласия.

Для части задач достаточно промежуточного варианта: сначала маскирование, потом внешний анализ, потом обратная связка результатов с внутренним идентификатором. Такой пайплайн я рекомендую чаще, чем прямую отправку исходных данных в облако. Если нужна архитектура с учётом 152-ФЗ, обычно начинаю с аудита процесса и схемы движения данных, а не с выбора конкретной модели.

Где локальный контур тоже ломается

Ошибка думать, что локально значит безопасно по умолчанию. Если в контуре нет разграничения доступов, логи не хранятся, администратор видит всё, а сотрудники выгружают результаты в Excel на ноутбук, нарушение просто меняет форму. Внутренний контроль нужен в любом случае.

По данным текста закона и разъяснительной практики, сам факт использования технологии не освобождает оператора от обязанностей по 152-ФЗ. То же подтверждает и Роскомнадзор в своём информационном контуре: отвечать будет компания, которая организовала обработку. Поэтому технический выбор всегда должен опираться на бизнес-цель, состав данных и контрольный след.

Большинство проблем с AI возникает не на этапе пилота, а на третьем месяце, когда сервис уже встроен в рутину и никто не смотрит на реальные маршруты данных. Закладывайте отдельный месяц на калибровку доступов, маскирование и проверку договоров после MVP.

Что проверить до запуска AI с персональными данными

Ниже чек-лист, который я бы дала руководителю, маркетологу и ИТ-команде в один документ. Он закрывает вопрос, какие данные нельзя отправлять без проверки, где нужно согласие и как проверить ai-сервис на соответствие 152-фз.

- Не отправляйте в внешний AI ФИО, телефоны, e-mail, адреса, номера документов, договоры, резюме, записи разговоров и биометрию без отдельной проверки сценария.

- Проверьте, есть ли согласие на обработку и передачу данных третьим лицам, если ваш кейс не покрывается договором или иным законным основанием.

- Определите, возникает ли трансграничная передача, если сервис, серверы или персонал вендора находятся вне РФ.

- Сверьте договор и политику сервиса: хранение запросов, обучение моделей, субподрядчики, порядок удаления и уведомления об инцидентах.

- Настройте обезличивание до отправки: маскирование полей, внутренние ID вместо прямых идентификаторов, запрет на ручную вставку сырых выгрузок.

- Назначьте владельца процесса: кто отвечает за юрпроверку, ИБ, доступы и контроль изменений после запуска.

Если на любой из этих пунктов нет документированного ответа, внедрение лучше остановить на 48 часов и провести короткий аудит. Это дешевле, чем запускать удобный сервис, который потом придётся срочно вынимать из процесса.

В 2025-2026 контроль усилился по двум направлениям сразу: выросла активность бизнеса в использовании AI и ужесточилось внимание к ПДн. В 2025 году поправки усилили ответственность за нарушения, а в 2026 компании уже активнее переводят чувствительные сценарии в локальные контуры или гибридные схемы с обезличиванием до передачи. Это нормальная зрелость рынка, а не временная реакция.

Безопасный AI для бизнеса начинается с ограничения данных, а не с выбора модели. Сначала уберите всё лишнее, потом проверьте правовое основание и только после этого решайте, нужен ли публичный сервис, локальная модель или кодовый контур.

Где процесс сломается, если не предусмотреть риски

Есть 3 типовых подводных камня, которые бизнес недооценивает. Я заранее смотрю именно их, потому что после 16 лет в аудите видно, где проект посыплется до запуска.

Первый — серое использование. Команда уже применяет AI с рабочими данными через личные аккаунты, а руководство считает, что пилот ещё не стартовал. Второй — ложное обезличивание, когда из текста убрали имя, но оставили достаточно контекста для повторной идентификации. Третий — неполный договор, в котором не описаны хранение, удаление, субобработка и уведомления об инцидентах.

Самая дорогая ошибка — считать compliance приложением к проекту. На практике compliance должен входить в архитектуру так же рано, как ИТ и бизнес-заказчик.

Решение для руководителя, который хочет AI без лишнего риска

Если коротко, то 152-фз нейросети совместимы только при управляемом процессе. Проверяйте не только сервис, но и весь путь данных: от формы на сайте до модели, логов и результата на стороне сотрудника.

Первое: отделите задачи, где AI работает на обезличенных данных, от задач, где ПДн неизбежны. Второе: для чувствительных сценариев выбирайте локальный или гибридный контур. Третье: фиксируйте правила в договорах, политике, инструкциях и логах. Так внедрение не превращается в лотерею.

Обо мне. Я — Марина Погодина, основательница PROMAREN. Раньше занималась аудитом ИТ-рисков (Большая четвёрка, ЦБ). Помогаю бизнесу в РФ строить автоматизацию кодом и на конструкторах.

Если вы уже используете AI и не уверены, где именно нарушаете закон, можно разобрать вашу ситуацию. Разбираю такие ситуации еженедельно в Telegram, MAX и статьях про 152-ФЗ.

Что ещё стоит учесть

Можно ли загружать базу клиентов в ChatGPT

По умолчанию не стоит. База клиентов почти всегда содержит персональные данные, а значит требует проверки правового основания, маршрута передачи, условий сервиса и режима хранения. Если сервис внешний и работает вне вашего контура, сначала оцените трансграничную передачу, договор и возможность обезличивания. Без этого риск нарушения слишком высок.

Что делать, если сотрудники уже передавали персональные данные нейросети

Сначала зафиксируйте масштаб. Нужно определить, какие данные ушли, через какой сервис, кто имел доступ и сохранялись ли запросы в истории. Затем остановите сценарий, соберите юридическую и ИБ-оценку, проверьте обязанность уведомления и обновите внутренние правила. Тянуть с разбором опасно, потому что следы быстро теряются.

Можно ли использовать данные клиентов для обучения AI-модели

Иногда можно, но только после отдельной правовой оценки. Для обучения модели важны цель обработки, состав данных, согласие на обработку, способ обезличивания и контроль доступа. Если данные остаются идентифицируемыми или модель обучается у внешнего поставщика, риск резко растёт. Без документированной проверки такой сценарий запускать не нужно.

Нужно ли согласие на обработку данных для AI

Зависит от кейса. В ряде процессов основанием может быть договор или иное основание по закону, но для передачи данных во внешний AI-сервис согласие часто требуется либо нужно отдельное юридическое обоснование. Оценивать это надо по конкретному процессу, а не по общему желанию внедрить AI в компании.

Как понять, что AI-сервис соответствует 152-ФЗ

Полного соответствия по рекламной фразе не бывает. Проверяйте договор, политику конфиденциальности, место хранения данных, возможность отключить обучение на запросах, порядок удаления, список субподрядчиков и фактическую архитектуру передачи. Если хотя бы по двум пунктам поставщик отвечает расплывчато, сервис нельзя считать проверенным для ПДн.

Чем локальная модель лучше публичного AI-сервиса

Локальная модель даёт больше контроля над инфраструктурой, доступами, логами и сроками хранения. Это особенно важно, когда в процессе есть клиентские, кадровые или финансовые данные. Она не снимает обязанностей по закону, но сокращает число неизвестных и упрощает внутренний контроль. Для чувствительных сценариев это часто более зрелый выбор.

Что считается персональными данными в переписке с AI

Персональными данными считается не только явное ФИО или телефон. Достаточно набора сведений, по которым можно прямо или косвенно определить человека: должность, адрес, номер заказа, жалоба, история покупки, редкое событие. Поэтому свободный текст в чате с AI тоже нужно проверять, даже если отдельных полей в форме нет.

Как использовать AI и не нарушить 152-ФЗ

Начинайте с карты данных. Нужно понять, что именно передаётся в модель, на каком основании, кто получает доступ, где хранятся данные и можно ли обезличить их до отправки. После этого выбирайте архитектуру: публичный сервис, гибридный вариант или локальный контур. Такой порядок надёжнее, чем запускать пилот и потом чинить последствия.